گزارش استفاده مسئولانه از هوش مصنوعی (Responsible Use of AI) توسط موسسه BAIR (Berkeley AI Research) در دانشگاه کالیفرنیا، برکلی تهیه شده است. این موسسه با هدف تحقیق و توسعه در زمینه هوش مصنوعی و مسئولیتهای اخلاقی مرتبط با آن فعالیت میکند. تیم تحقیقاتی این موسسه متشکل از پژوهشگران و استادان برجستهای است که در زمینههای مختلف هوش مصنوعی و اخلاقیات آن تخصص دارند.

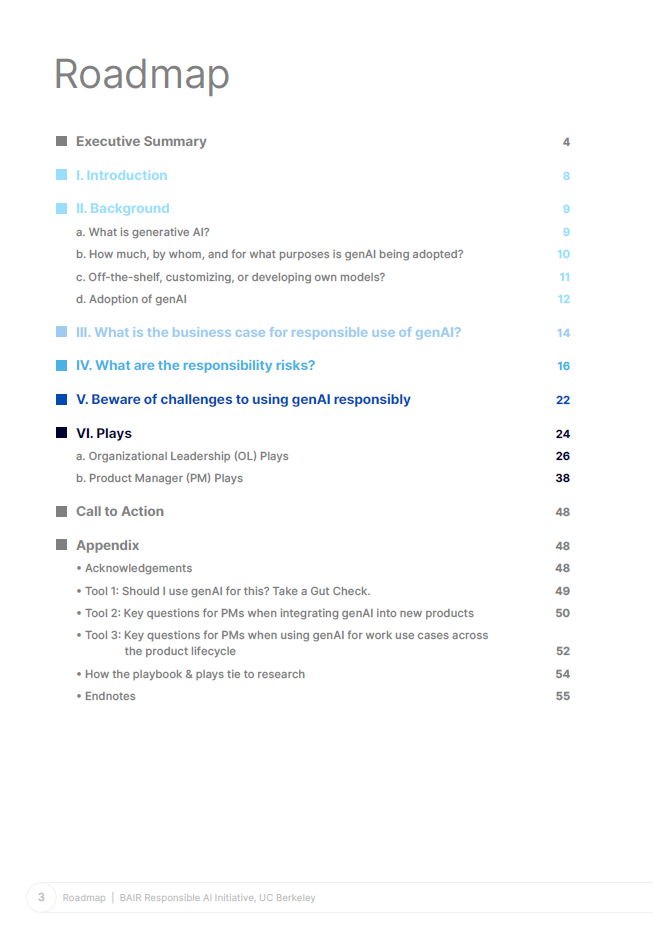

موضوع اصلی گزارش استفاده مسئولانه از هوش مصنوعی (Responsible Use of AI) به بررسی چالشها و فرصتهای استفاده از هوش مصنوعی در محیطهای کاری و محصولات جدید میپردازد. با گسترش روزافزون فناوریهای هوش مصنوعی، نیاز به استفاده مسئولانه از این ابزارها بیش از پیش احساس میشود. این گزارش شامل ۱۰ بازی (play) برای مدیران محصول و رهبران سازمانی است که میتوانند به استفاده ایمن و مسئولانه از هوش مصنوعی کمک کنند.

۱. اهمیت استفاده مسئولانه از هوش مصنوعی

استفاده مسئولانه از هوش مصنوعی نه تنها به کاهش خطرات و آسیبهای احتمالی کمک میکند، بلکه میتواند به ایجاد اعتماد و مسئولیتپذیری در سازمانها نیز منجر شود. این موضوع به ویژه در زمینههای حساس مانند حریم خصوصی دادهها، شفافیت، و امنیت اطلاعات از اهمیت بالایی برخوردار است.

۲. چالشهای استفاده از هوش مصنوعی

گزارش به چالشهای مختلفی که سازمانها در استفاده از هوش مصنوعی با آنها مواجه هستند، اشاره میکند. این چالشها شامل:

– حریم خصوصی دادهها: مدلهای هوش مصنوعی ممکن است دادههای کاربران را ذخیره کنند که میتواند به نقض حریم خصوصی منجر شود.

– شفافیت: نبود شفافیت در نحوه عملکرد مدلها میتواند منجر به عدم اعتماد کاربران شود.

– دقت و صحت: مدلهای هوش مصنوعی ممکن است اطلاعات نادرستی تولید کنند که میتواند به تصمیمگیریهای نادرست منجر شود.

– تعصب: مدلهای هوش مصنوعی ممکن است تعصبات موجود در دادههای آموزشی را منعکس کنند و به تداوم نابرابریها کمک کنند.

– امنیت و ایمنی: آسیبپذیریهای امنیتی میتوانند به سوءاستفاده از اطلاعات حساس منجر شوند.

۳. بازیها و استراتژیهای پیشنهادی

گزارش استفاده مسئولانه از هوش مصنوعی (Responsible Use of AI) شامل پنج بازی برای رهبران سازمانی و پنج بازی برای مدیران محصول است. این بازیها به شرح زیر هستند:

الف. بازیهای رهبران سازمانی

1. تعهد به مسئولیتپذیری: رهبران باید ارزش استفاده مسئولانه از هوش مصنوعی را در سازمان خود شناسایی کرده و اصولی را برای راهنمایی تصمیمگیریهای اخلاقی تدوین کنند.

2. پیادهسازی سیاستها: سازمانها باید سیاستهای مشخصی برای استفاده از هوش مصنوعی تدوین کنند که شامل روشهای قابل قبول و غیرقابل قبول باشد.

3. چارچوب حاکمیتی: ایجاد یک چارچوب حاکمیتی مسئولانه که نقشها و مسئولیتها را تعریف کند و فرهنگ مسئولیتپذیری را ترویج دهد.

4. آموزش و توانمندسازی: آموزش کارکنان در زمینه استفاده مسئولانه از هوش مصنوعی و ایجاد ابزارهای لازم برای این کار.

5. تعیین مشوقها: بهروز کردن مشوقها و معیارهای عملکرد به گونهای که مسئولیتپذیری را در اولویت قرار دهد.

ب. بازیهای مدیران محصول

1. ارزیابی ریسکها: مدیران باید برای ارزیابی ریسکهای احتمالی در استفاده از هوش مصنوعی اقدام کنند.

2. انتخاب مدل مناسب: انتخاب مدلهای هوش مصنوعی با توجه به نیازها و ریسکهای مرتبط، و اطمینان از شفافیت در انتخابها.

3. بررسی و ارزیابی: انجام بررسیها و ارزیابیهای دقیق قبل و بعد از راهاندازی محصولات هوش مصنوعی.

4. آزمایشهای رو در رو: انجام آزمایشهای رو در رو و تستهای مخالف برای شناسایی آسیبپذیریها.

5. ثبت لحظات مسئولیتپذیری: مدیران باید لحظات مسئولیتپذیری خود را ثبت و در ارزیابیهای عملکرد خود به کار ببرند.

گزارش استفاده مسئولانه از هوش مصنوعی (Responsible Use of AI) به سازمانها و مدیران محصول کمک میکند تا با درک چالشها و فرصتها، به استفادهای مسئولانه و اخلاقی از هوش مصنوعی بپردازند. این گزارش بهویژه بر اهمیت آموزش، شفافیت، و ایجاد چارچوبهای حاکمیتی تأکید دارد. با پیادهسازی اصول و بازیهای پیشنهادی در این گزارش، سازمانها میتوانند از مزایای هوش مصنوعی بهرهمند شوند و در عین حال به حفظ حریم خصوصی، دقت، و امنیت اطلاعات کاربران توجه داشته باشند.

این گزارش به عنوان یک راهنما برای رهبران سازمانی و مدیران محصول در راستای استفاده مسئولانه از هوش مصنوعی عمل میکند و به آنها کمک میکند تا در این عصر نوین فناوری، به مسئولیتپذیری و اخلاق در تصمیمگیریهای خود توجه بیشتری داشته باشند.

نقد و بررسیها

هنوز بررسیای ثبت نشده است.